Estadística

La estadística (la forma femenina del alemán Statistik, y este derivado del italiano statista 'hombre de Estado')1 es una ciencia formal y una herramienta que estudia usos y análisis provenientes de una muestra representativa de datos, busca explicar las correlaciones y dependencias de un fenómeno físicoo natural, de ocurrencia en forma aleatoria o condicional.

Es transversal a una amplia variedad de disciplinas, desde la física hasta las ciencias sociales, desde las ciencias de la salud hasta el control de calidad. Además, se usa en áreas de negocios o instituciones gubernamentales ya que su principal objetivo es describir al conjunto de datos obtenidos para la toma de decisiones o bien, para realizar generalizaciones sobre las características observadas.

Hoy en día, la estadística es una ciencia que se encarga de estudiar una determinada población por medio de la recolección, recopilación e interpretación de datos. Del mismo modo, también es considerada una técnica especial apta para el estudio cuantitativo de los fenómenos de masa o colectivo.

La estadística se divide en dos grandes áreas:

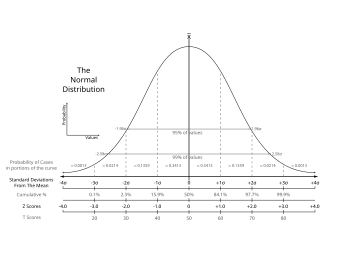

- Estadística descriptiva: Se dedica a la descripción, visualización y resumen de datos originados a partir de los fenómenos de estudio. Los datos pueden ser resumidos numérica o gráficamente. Su objetivo es organizar y describir las características sobre un conjunto de datos con el propósito de facilitar su aplicación, generalmente con el apoyo de gráficas, tablas o medidas numéricas.

- Ejemplos básicos de parámetros estadísticos son: la media y la desviación estándar.

- Ejemplos gráficos son: histograma, pirámide poblacional, gráfico circular, entre otros.

- Estadística inferencial: Se dedica a la generación de los modelos, inferencias y predicciones asociadas a los fenómenos en cuestión teniendo en cuenta la aleatoriedad de las observaciones. Se usa para modelar patrones en los datos y extraer inferencias acerca de la población bajo estudio. Estas inferencias pueden tomar la forma de respuestas a preguntas sí/no (prueba de hipótesis), estimaciones de unas características numéricas (estimación), pronósticos de futuras observaciones, descripciones de asociación (correlación) o modelamiento de relaciones entre variables (análisis de regresión). Otras técnicas demodelamiento incluyen análisis de varianza, series de tiempo y minería de datos. Su objetivo es obtener conclusiones útiles para lograr hacer deducciones acerca de la totalidad de todas las observaciones hechas, basándose en la información numérica.

Ambas ramas (descriptiva e inferencial) comprenden la estadística aplicada, pero la estadística inferencial, por su parte, se divide en estadística paramétrica y estadística no paramétrica.

Existe también una disciplina llamada estadística matemática, la que se refiere a las bases teóricas de la materia. La palabra «estadísticas» también se refiere al resultado de aplicar un algoritmo estadístico a un conjunto de datos, como en estadísticas económicas, estadísticas criminales, etc.

Historia[editar]

Origen[editar]

El término alemán Statistik, introducido originalmente por Gottfried Achenwall en 1749, se refería al análisis de datos del Estado, es decir, la «ciencia del Estado» (o más bien, de la ciudad-estado). También se llamóaritmética política de acuerdo con la traducción literal del inglés. No fue hasta el siglo XIX cuando el término estadística adquirió el significado de recolectar y clasificar datos. Este concepto fue introducido por el militar británico sir John Sinclair (1754-1835).

En su origen, por tanto, la estadística estuvo asociada a los Estados o ciudades libres, para ser utilizados por el gobierno y cuerpos administrativos (a menudo centralizados). La colección de datos acerca de estados y localidades continúa ampliamente a través de los servicios de estadística nacionales e internacionales. En particular, los censos comenzaron a suministrar información regular acerca de la población de cada país. Así pues, los datos estadísticos se referían originalmente a los datos demográficos de una ciudad o Estado determinados. Y es por ello que en la clasificación decimal de Melvil Dewey, empleada en las bibliotecas, todas las obras sobre estadística se encuentran ubicadas al lado de las obras de o sobre la demografía.

También La estadística es la parte de las Matemáticas que se encarga del estudio de una determinada característica en una población, recogiendo los datos, organizándolos en tablas, representándolos gráficamente y analizándolos para sacar conclusiones de dicha población

Ya se utilizaban representaciones gráficas y otras medidas en pieles, rocas, palos de madera y paredes de cuevas para controlar el número de personas, animales o ciertas mercancías. Hacia el año 3000 a. C. los babilonios usaban ya pequeños envases moldeados de arcilla para recopilar datos sobre la producción agrícola y de los géneros vendidos o cambiados. Los egipcios analizaban los datos de la población y la renta del país mucho antes de construir las pirámides en el siglo XI a. C. Los libros bíblicos de Números y Crónicas incluyen en algunas partes trabajos de estadística. El primero contiene dos censos de la población de laTierra de Israel y el segundo describe el bienestar material de las diversas tribus judías. En China existían registros numéricos similares con anterioridad al año 2000 a. C. Los antiguos griegos realizaban censos cuya información se utilizaba hacia el 594 a. C. para cobrar impuestos.

Empleo de la estadística en las Antiguas Civilizaciones[editar]

En la Edad Antigua la estadística consistía en elaborar censos (de población y tierras). Su objetivo era facilitar la gestión de las labores tributarias, obtener datos sobre el número de personas que podrían servir en el ejército o establecer repartos de tierras u otros bienes.

- En Egipto: La estadística comienza con la Dinastía I, en el año 3050 a.C.. Los faraones ordenaban la realización de censos con la finalidad de obtener los datos sobre tierras y riquezas para poder planificar la construcción de las pirámides.

- En China: Año 2238 a.C. el emperador Yao elabora un censo general sobre la actividad agrícola, industrial y comercial.

- En la Antigua Grecia: Se realizaron censos para cuantificar la distribución y posesión de la tierra y otras riquezas, organizar el servicio militar y determinar el derecho al voto.

- En la Antigua Roma: Durante el Imperio Romano se establecieron registros de nacimientos y defunciones, y se elaboraron estudios sobre los ciudadanos, sus tierras y sus riquezas.

- En México: Año 1116, durante la segunda migración de las tribus chichimecas, el rey Xólotl ordenó que fueran censados los súbditos.

- En el Oriente Medio, bajo el dominio sumerio, Babilonia tenía casi 6000 habitantes. Se encontraron en ella tablillas de arcilla que registraban los negocios y asuntos legales de la ciudad.

- El censo en el pueblo judío sirvió, además de propósitos militares, para calcular el monto de los ingresos del templo.

Durante la Edad Media la estadística no presentó grandes avances, pero destaca el trabajo de Isidoro de Sevilla, quien recopiló y clasificó datos de diversa naturaleza cuyos resultados fueron publicados en la obraOriginum sive Etymologiarum.

En la Edad Moderna se continúa con la obtención de censos.

- En España: Destaca el censo de Pecheros (1528), el de los Obispos (1587), el Censo de los Millones (1591) o el Censo del Conde de Aranda (1768).

- En Inglaterra: la peste de la década de 1500 provocó un aumento en la contabilización de los datos sobre defunciones y nacimientos.

Orígenes en probabilidad[editar]

Los métodos estadístico-matemáticos emergieron desde la teoría de probabilidad, la cual data desde la correspondencia entre Pascal y Pierre de Fermat (1654). Christian Huygens (1657) da el primer tratamiento científico que se conoce a la materia. El Ars coniectandi (póstumo, 1713) de Jakob Bernoulli y la Doctrina de posibilidades (1718) de Abraham de Moivre estudiaron la materia como una rama de las matemáticas.2 En la era moderna, el trabajo de Kolmogórov ha sido un pilar en la formulación del modelo fundamental de la Teoría de Probabilidades, el cual es usado a través de la estadística.

La teoría de errores se puede remontar a la Ópera miscellánea (póstuma, 1722) de Roger Cotes y al trabajo preparado por Thomas Simpson en 1755 (impreso en 1756) el cual aplica por primera vez la teoría de la discusión de errores de observación. La reimpresión (1757) de este trabajo incluye el axioma de que errores positivos y negativos son igualmente probables y que hay unos ciertos límites asignables dentro de los cuales se encuentran todos los errores; se describen errores continuos y una curva de probabilidad.

Pierre-Simon Laplace (1774) hace el primer intento de deducir una regla para la combinación de observaciones desde los principios de la teoría de probabilidades. Laplace representó la Ley de probabilidades de errores mediante una curva y dedujo una fórmula para la media de tres observaciones. También, en 1871, obtiene la fórmula para la ley de facilidad del error (término introducido por Lagrange, 1744) pero con ecuaciones inmanejables. Daniel Bernoulli (1778) introduce el principio del máximo producto de las probabilidades de un sistema de errores concurrentes.

El método de mínimos cuadrados, el cual fue usado para minimizar los errores en mediciones, fue publicado independientemente por Adrien-Marie Legendre (1805), Robert Adrain (1808), y Carl Friedrich Gauss (1809). Gauss había usado el método en su famosa predicción de la localización del planeta enano Ceres en 1801. Pruebas adicionales fueron escritas por Laplace (1810, 1812), Gauss (1823), James Ivory (1825, 1826), Hagen (1837), Friedrich Bessel (1838), W. F. Donkin (1844, 1856), John Herschel (1850) yMorgan Crofton (1870). Otros contribuidores fueron Ellis (1844), Augustus De Morgan (1864), Glaisher (1872) y Giovanni Schiaparelli (1875). La fórmula de Peters para , el probable error de una observación simple es bien conocido.

El siglo XIX incluye autores como Laplace, Silvestre Lacroix (1816), Littrow (1833), Richard Dedekind (1860), Helmert (1872), Hermann Laurent (1873), Liagre y Didion. Augustus De Morgan y George Boole mejoraron la presentación de la teoría. Adolphe Quetelet (1796-1874), fue otro importante fundador de la estadística y quien introdujo la noción del «hombre promedio» (l’homme moyen) como un medio de entender los fenómenos sociales complejos tales como tasas de criminalidad, tasas de matrimonio o tasas de suicidios.

Siglo XX[editar]

El campo moderno de la estadística se emergió a los principios del siglo XX dirigida por la obra de Francis Galton y Karl Pearson, quienes transformaron la estadística a convertirse en una disciplina matemática rigurosa usada por análisis, no solamente en la ciencia sino en la manufactura y la política. Las contribuciones de Galton incluyen los conceptos de desviación típica, correlación, análisis de la regresión y la aplicación de estos métodos al estudio de la variedad de características –la altura, el peso entre otros.3Pearson desarrolló el Coeficiente de correlación de Pearson, definió como un momento-producto,4 el método de momentos por caber las distribuciones a las muestras y ladistribuciones de Pearson, entre otras cosas.5 Galton y Pearson se fundaron Biometrika como su primera revista de la estadística matemática y la bioestadística (en aquel entonces conocida como la biometría). Pearson también fundó el primer departamento de estadística en University College de Londres.6

Durante el siglo XX, la creación de instrumentos precisos para asuntos de salud pública (epidemiología, bioestadística, etc.) y propósitos económicos y sociales (tasa dedesempleo, econometría, etc.) necesitó de avances sustanciales en las prácticas estadísticas.

La segunda ola de los años 1910 y 1920 se inició William Gosset, y se culminó en la obra de Ronald Fisher, quién escribió los libros de texto que iban a definir la disciplina académica en universidades en todos lados del mundo. Sus publicaciones más importantes fueron su papel de 1918 The Correlation between Relatives on the Supposition of Mendelian Inheritance, lo cual era el primero en usar el término estadístico varianza, su obra clásica de 1925 Statistical Methods for Research Workers y su 1935 The Design of Experiments,9 10 11 12 donde desarrolló los modelos rigurosos de diseño experimental. Originó el concepto de suficiencia y la información de Fisher.13 En su libro de 1930The Genetical Theory of Natural Selection aplicó la estadística a varios conceptos en la biología como el Principio de Fisher14 14 (sobre el ratio de sexo), el Fisherian runaway,15 16 17 18 19 20 un concepto en la selección sexual sobre una realimentación positiva efecto hallado en la evolución.

Estado actual[editar]

Hoy el uso de la estadística se ha extendido más allá de sus orígenes como un servicio al Estado o al gobierno. Personas y organizaciones usan la estadística para entender datos y tomar decisiones en ciencias naturales y sociales, medicina, negocios y otras áreas. La estadística es entendida generalmente no como un sub-área de las matemáticas sino como una ciencia diferente «aliada». Muchas universidades tienen departamentos académicos de matemáticas y estadística separadamente. La estadística se enseña en departamentos tan diversos como psicología, educación y salud pública.

Al aplicar la estadística a un problema científico, industrial o social, se comienza con un proceso o población a ser estudiado. Esta puede ser la población de un país, de granos cristalizados en una roca o de bienes manufacturados por una fábrica en particular durante un periodo dado. También podría ser un proceso observado en varios instantes y los datos recogidos de esta manera constituyen una serie de tiempo.

Por razones prácticas, en lugar de compilar datos de una población entera, usualmente se estudia un subconjunto seleccionado de la población, llamado muestra. Datos acerca de la muestra son recogidos de manera observacional o experimental. Los datos son entonces analizados estadísticamente lo cual sigue dos propósitos: descripción e inferencia.

El concepto de correlación es particularmente valioso. Análisis estadísticos de un conjunto de datos puede revelar que dos variables (esto es, dos propiedades de la población bajo consideración) tienden a variar conjuntamente, como si hubiera una conexión entre ellas. Por ejemplo, un estudio del ingreso anual y la edad de muerte podría resultar en que personas pobres tienden a tener vidas más cortas que personas de mayor ingreso. Las dos variables se dice que están correlacionadas. Sin embargo, no se puede inferir inmediatamente la existencia de una relación de causalidad entre las dos variables. El fenómeno correlacionado podría ser la causa de una tercera, previamente no considerada, llamada variable confusora.

Si la muestra es representativa de la población, inferencias y conclusiones hechas en la muestra pueden ser extendidas a la población completa. Un problema mayor es el de determinar cuán representativa es la muestra extraída. La estadística ofrece medidas para estimar y corregir por aleatoriedad en la muestra y en el proceso de recolección de los datos, así como métodos para diseñar experimentos robustos como primera medida, ver diseño experimental.

El concepto matemático fundamental empleado para entender la aleatoriedad es el de probabilidad. La estadística matemática (también llamada teoría estadística) es la rama de las matemáticas aplicadas que usa la teoría de probabilidades y el análisis matemático para examinar las bases teóricas de la estadística.

El uso de cualquier método estadístico es válido solo cuando el sistema o población bajo consideración satisface los supuestos matemáticos del método. El mal uso de la estadística puede producir serios errores en la descripción e interpretación, lo cual podría llegar a afectar políticas sociales, la práctica médica y la calidad de estructuras tales como puentes y plantas de reacción nuclear.

Incluso cuando la estadística es correctamente aplicada, los resultados pueden ser difíciles de interpretar por un inexperto. Por ejemplo, el significado estadístico de una tendencia en los datos, que mide el grado al cual la tendencia puede ser causada por una variación aleatoria en la muestra, puede no estar de acuerdo con el sentido intuitivo. El conjunto de habilidades estadísticas básicas (y el escepticismo) que una persona necesita para manejar información en el día a día se refiere como «cultura estadística».

Métodos estadísticos[editar]

Estudios experimentales y observacionales[editar]

Un objetivo común para un proyecto de investigación estadística es investigar la causalidad, y en particular extraer una conclusión en el efecto que algunos cambios en los valores de predictores o variables independientes tienen sobre una respuesta o variables dependientes. Hay dos grandes tipos de estudios estadísticos para estudiar causalidad: estudios experimentales y observacionales. En ambos tipos de estudios, el efecto de las diferencias de una variable independiente (o variables) en el comportamiento de una variable dependiente es observado. La diferencia entre los dos tipos es la forma en que el estudio es conducido. Cada uno de ellos puede ser muy efectivo.

Niveles de medición[editar]

Hay cuatro tipos de mediciones o escalas de medición en estadística: niveles de medición (nominal, ordinal, intervalo y razón). Tienen diferentes grados de uso en la investigación estadística. Las medidas de razón, en donde un valor cero y distancias entre diferentes mediciones son definidas, dan la mayor flexibilidad en métodos estadísticos que pueden ser usados para analizar los datos. Las medidas de intervalo tienen distancias interpretables entre mediciones, pero un valor cero sin significado (como las mediciones de coeficiente intelectual o temperatura en grados Celsius). Las medidas ordinales tienen imprecisas diferencias entre valores consecutivos, pero un orden interpretable para sus valores. Las medidas nominales no tienen ningún rango interpretable entre sus valores.

La escala de medida nominal, puede considerarse la escala de nivel más bajo. Se trata de agrupar objetos en clases. La escala ordinal, por su parte, recurre a la propiedad de «orden» de los números. La escala de intervalos iguales está caracterizada por una unidad de medida común y constante. Es importante destacar que el punto cero en las escalas de intervalos iguales es arbitrario, y no refleja en ningún momento ausencia de la magnitud que estamos midiendo. Esta escala, además de poseer las características de la escala ordinal, permite determinar la magnitud de los intervalos (distancia) entre todos los elementos de la escala. La escala de coeficientes o Razones es el nivel de medida más elevado y se diferencia de las escalas de intervalos iguales únicamente por poseer un punto cero propio como origen; es decir que el valor cero de esta escala significa ausencia de la magnitud que estamos midiendo. Si se observa una carencia total de propiedad, se dispone de una unidad de medida para el efecto. A iguales diferencias entre los números asignados corresponden iguales diferencias en el grado de atributo presente en el objeto de estudio.

Técnicas de análisis estadístico[editar]

- Prueba t de Student

- Prueba de χ²

- Análisis de varianza (ANOVA)

- U de Mann-Whitney

- Análisis de regresión

- Correlación

- Iconografía de las correlaciones

- Frecuencia estadística

- Análisis de frecuencia acumulada

- Prueba de la diferencia menos significante de Fisher

- Coeficiente de correlación de Pearson

- Coeficiente de correlación de Spearman

- Análisis factorial exploratorio

- Análisis factorial confirmatorio

- Gráfica estadística

Lenguaje y simbología[editar]

Población y muestra[editar]

- Población: Es el todo o un conjunto formado por todos los valores existentes, ya sean personas, medidas u objetos que pueden ser expresados mediante una variable y además, tienen una característica; de que son de interés estadístico para un estudio en específico. Al análisis completo de la población también se le suele conocer como "censo".

- Población finita: Es aquella que expresa que es posible sobrepasarse al contar o bien, alcanzarse; por lo tanto, es la que tiene o incluye un número limitado ya sea de objetos, medidas o personas. Por ejemplo: el gasto en comida durante cierto tiempo, un conjunto de calificaciones o bien, el total de alumnos que estudian en una universidad.

- Población infinita: Es aquella que incluye a un gran número de conjunto de observaciones o medidas que no se pueden alcanzar con el conteo. Esto quiere decir que tiene un número ilimitado de valores, por ejemplo: la producción futura de una máquina o el lanzamiento de dados o una moneda.

- Muestra: Es aquel subconjunto perteneciente a una población. Esto quiere decir que se conforma por algunos datos de ésta, ya sean ciertos objetos, personas, o medidas de la población. Al estudio de este concepto se le suele conocer como "muestreo".

- Muestra representativa: Es aquel subconjunto representativo de una población, pero para que se consideren así se deben seguir ciertos procedimientos de selección o bien, un método de muestreo. Se dice que la muestra adecuada es aquella que contiene características esenciales de la población para lograr el objetivo de hacer generalizaciones con respecto al total de los datos sin examinar cada uno de ellos.

Parámetro y estadístico[editar]

- Parámetro: Es la medida de cierta característica numérica de una población que generalmente se expresa mediante símbolos griegos (μ ó σ)

No hay comentarios:

Publicar un comentario